Hallo,

ich hoffe, mir kann jemand von Euch weiterhelfen.

Nach einem Upgrade von Virtualbox gab die Installation aus, dass der Server rebootet werden müsse. Daher gab ich ein "reboot" ein und stellte fest, dass der FreeBSD-10.3-Server anschließend nicht mehr erreichbar war.

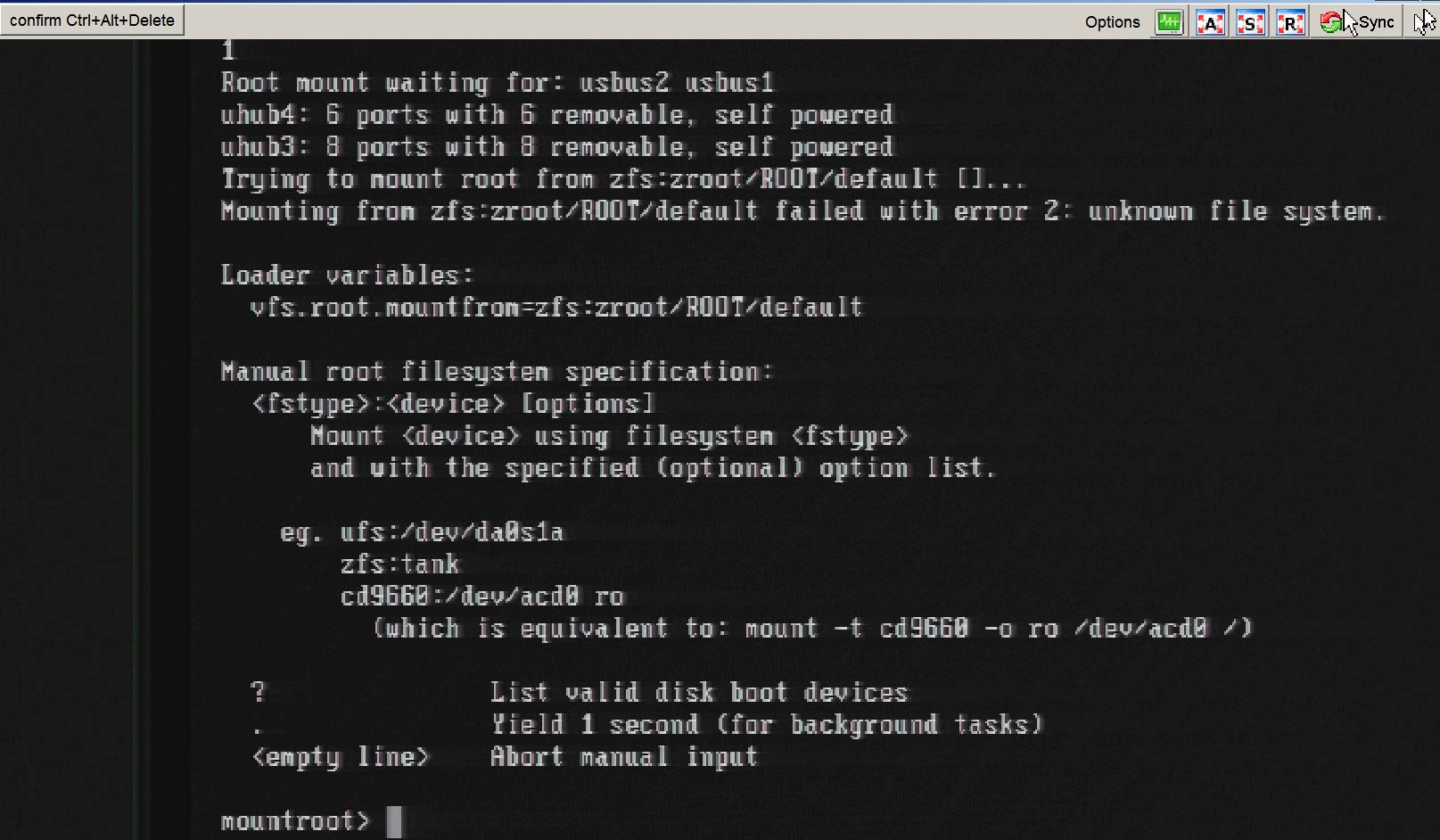

Hetzner koppelte dann ein Lantronix-Konsole an, der sich folgendes entnehmen ließ:

Ein Hardwarefehler an den Platten liegt m. E. nicht vor.

Konnte dann mittels Hetzner-Rescue-System (FreeBSD 10.3 64 Bit)

mit

mkdir /tmp/bootpool

zpool import -f zroot

auf die Verzeichnisse auf den beiden SATA-Platten zugreifen.

Es scheint so, als ob der ZFS-Dienst Probleme macht oder möglicherweise nicht kompatibel ist, weil er vlt. nach einem OS-Upgrade nicht aktualisiert worden war.

[root@rescue ~]# zpool status zroot

internal error: failed to initialize ZFS library

[root@rescue ~]# zpool get all zroot

internal error: failed to initialize ZFS library

Sowohl in rc.conf als auch in loader.conf ist zfs aktiviert.

Es handelt sich bei dem OS auf dem Server um ein FreeBSD 10.3 64 Bit (dieses habe ich daher auch als Rescuemedium gewählt!).

Ich vermute, dass die Tatsache, dass ich bei diversen Kommandos ein

"failed to initialize ZFS library" erhalte, die Ursache des Problems ist:

[root@rescue ~]# zpool import

internal error: failed to initialize ZFS library

[root@rescue ~]# service zfs start

ps: empty file: Invalid argument

ps: empty file: Invalid argument

internal error: failed to initialize ZFS library

internal error: failed to initialize ZFS library

vgl. auch unten "Ausgaben".

Für hilfreiche Hinweise und Ideen wäre ich sehr dankbar, da ich nun schon einige Stunden versucht habe, das Ganze wieder zum Laufen zu bringen.

Viele Grüße

testit

Ausgaben:

gpart show:

root@rescue ~]# mount

[root@rescue ~]# geom disk list

Ausgabe von dmesg.boot

Der Versuch, den Bootcode neu anzulegen und damit ggf. auch die ZFS-Kompatibilität herzustellen, warf folgende Fehler:

[root@rescue ~]# gpart bootcode -b /boot/pmbr -p /boot/gptzfsboot -i 1 ada0

gpart: No such geom: ada0.

[root@rescue ~]# gpart bootcode -b /boot/pmbr -p /boot/gptzfsboot -i 1 ad0

gpart: No such geom: ad0.

ich hoffe, mir kann jemand von Euch weiterhelfen.

Nach einem Upgrade von Virtualbox gab die Installation aus, dass der Server rebootet werden müsse. Daher gab ich ein "reboot" ein und stellte fest, dass der FreeBSD-10.3-Server anschließend nicht mehr erreichbar war.

Hetzner koppelte dann ein Lantronix-Konsole an, der sich folgendes entnehmen ließ:

Ein Hardwarefehler an den Platten liegt m. E. nicht vor.

Konnte dann mittels Hetzner-Rescue-System (FreeBSD 10.3 64 Bit)

mit

mkdir /tmp/bootpool

zpool import -f zroot

auf die Verzeichnisse auf den beiden SATA-Platten zugreifen.

Es scheint so, als ob der ZFS-Dienst Probleme macht oder möglicherweise nicht kompatibel ist, weil er vlt. nach einem OS-Upgrade nicht aktualisiert worden war.

[root@rescue ~]# zpool status zroot

internal error: failed to initialize ZFS library

[root@rescue ~]# zpool get all zroot

internal error: failed to initialize ZFS library

Sowohl in rc.conf als auch in loader.conf ist zfs aktiviert.

Es handelt sich bei dem OS auf dem Server um ein FreeBSD 10.3 64 Bit (dieses habe ich daher auch als Rescuemedium gewählt!).

Ich vermute, dass die Tatsache, dass ich bei diversen Kommandos ein

"failed to initialize ZFS library" erhalte, die Ursache des Problems ist:

[root@rescue ~]# zpool import

internal error: failed to initialize ZFS library

[root@rescue ~]# service zfs start

ps: empty file: Invalid argument

ps: empty file: Invalid argument

internal error: failed to initialize ZFS library

internal error: failed to initialize ZFS library

vgl. auch unten "Ausgaben".

Für hilfreiche Hinweise und Ideen wäre ich sehr dankbar, da ich nun schon einige Stunden versucht habe, das Ganze wieder zum Laufen zu bringen.

Viele Grüße

testit

Ausgaben:

gpart show:

=> 34 5860533101 ada1 GPT (2.7T)

34 1024 1 freebsd-boot (512K)

1058 4194304 2 freebsd-swap (2.0G)

4195362 5856337773 3 freebsd-zfs (2.7T)

=> 34 5860533101 diskid/DISK-WD-WMC130D1NZWV GPT (2.7T)

34 1024 1 freebsd-boot (512K)

1058 4194304 2 freebsd-swap (2.0G)

4195362 5856337773 3 freebsd-zfs (2.7T)

root@rescue ~]# mount

[

/dev/md0 on / (ufs, local)

devfs on /dev (devfs, local, multilabel)

tmpfs on /tmp (tmpfs, local)

tmpfs on /usr (tmpfs, local)

nfs.hetzner.de:/nfs/freebsd on /nfs (nfs)

zroot/ROOT/default on / (zfs, local, noatime, nfsv4acls)

zroot/tmp on /tmp (zfs, local, noatime, nosuid, nfsv4acls)

zroot/usr/home on /usr/home (zfs, local, noatime, nfsv4acls)

zroot/usr/ports on /usr/ports (zfs, local, noatime, nosuid, nfsv4acls)

zroot/usr/src on /usr/src (zfs, local, noatime, nfsv4acls)

zroot/var/crash on /var/crash (zfs, local, noatime, noexec, nosuid, nfsv4acls)

zroot/var/log on /var/log (zfs, local, noatime, noexec, nosuid, nfsv4acls)

zroot/var/mail on /var/mail (zfs, local, nfsv4acls)

zroot/var/tmp on /var/tmp (zfs, local, noatime, nosuid, nfsv4acls)

zroot/vms on /vms (zfs, local, noatime, nfsv4acls)

[root@rescue ~]# geom disk list

Geom name: ada0

Providers:

1. Name: ada0

Mediasize: 3000592982016 (2.7T)

Sectorsize: 512

Mode: r1w1e3

descr: WDC WD3000FYYZ-01UL1B2

lunid: 50014ee003f4cf78

ident: WD-WMC130D1NZWV

rotationrate: 7200

fwsectors: 63

fwheads: 16

Geom name: ada1

Providers:

1. Name: ada1

Mediasize: 3000592982016 (2.7T)

Sectorsize: 512

Mode: r1w1e3

descr: WDC WD3000FYYZ-01UL1B2

lunid: 50014ee20b6bcb65

ident: WD-WCC135FTXZTY

rotationrate: 7200

fwsectors: 63

fwheads: 16

Ausgabe von dmesg.boot

egrep 'da[0-9]|cd[0-9]' /var/run/dmesg.boot

ada0 at ahcich0 bus 0 scbus0 target 0 lun 0

ada0: <WDC WD3000FYYZ-01UL1B2 01.01K03> ATA8-ACS SATA 3.x device

ada0: Serial Number WD-WMC130D1NZWV

ada0: 600.000MB/s transfers (SATA 3.x, UDMA6, PIO 8192bytes)

ada0: Command Queueing enabled

ada0: 2861588MB (5860533168 512 byte sectors)

ada0: Previously was known as ad4

ada1 at ahcich1 bus 0 scbus1 target 0 lun 0

ada1: <WDC WD3000FYYZ-01UL1B2 01.01K03> ATA8-ACS SATA 3.x device

ada1: Serial Number WD-WCC135FTXZTY

ada1: 600.000MB/s transfers (SATA 3.x, UDMA6, PIO 8192bytes)

ada1: Command Queueing enabled

ada1: 2861588MB (5860533168 512 byte sectors)

ada1: Previously was known as ad6

Der Versuch, den Bootcode neu anzulegen und damit ggf. auch die ZFS-Kompatibilität herzustellen, warf folgende Fehler:

[root@rescue ~]# gpart bootcode -b /boot/pmbr -p /boot/gptzfsboot -i 1 ada0

gpart: No such geom: ada0.

[root@rescue ~]# gpart bootcode -b /boot/pmbr -p /boot/gptzfsboot -i 1 ad0

gpart: No such geom: ad0.