Hallo,

ich habe meinen Server auf FreeBSD migriert und bin gerade dabei den ZFS-Datenpool zu erstellen und zu testen.

Dazu habe ich 6 x 3 TB Festplatten hergenommen und mittels gnop (4k) zu einem RaidZ2 zusammengeführt.

Bevor ich ZIL und L2ARC hinzufüge (jeweils zusätzliche Partitionen der System-SSDs) habe ich mal versucht mit bonnie++ einen Benchmark zu erstellen.

Bei der Einrichtung bin ich folgendermaßen vorgegangen:

Anlegen fester Partitionsgrößen (teilweise unterscheiden sich die ja je nach Festplatte)

gpart create -s GPT da0

gpart create -s GPT da1

gpart create -s GPT da2

gpart create -s GPT da3

gpart create -s GPT da4

gpart create -s GPT da5

gpart add -b 2048 -s 5860333168 -t freebsd-zfs -l data00 da0

gpart add -b 2048 -s 5860333168 -t freebsd-zfs -l data01 da1

gpart add -b 2048 -s 5860333168 -t freebsd-zfs -l data02 da2

gpart add -b 2048 -s 5860333168 -t freebsd-zfs -l data03 da3

gpart add -b 2048 -s 5860333168 -t freebsd-zfs -l data04 da4

gpart add -b 2048 -s 5860333168 -t freebsd-zfs -l data05 da5

4k-Thematik

gnop create -S 4096 /dev/gpt/data00

gnop create -S 4096 /dev/gpt/data01

gnop create -S 4096 /dev/gpt/data02

gnop create -S 4096 /dev/gpt/data03

gnop create -S 4096 /dev/gpt/data04

gnop create -S 4096 /dev/gpt/data05

zpool create zdata raidz2 /dev/gpt/data00.nop /dev/gpt/data01.nop /dev/gpt/data02.nop /dev/gpt/data03.nop /dev/gpt/data04.nop /dev/gpt/data05.nop

zpool export zdata

gnop destroy /dev/gpt/data00.nop /dev/gpt/data01.nop /dev/gpt/data02.nop /dev/gpt/data03.nop /dev/gpt/data04.nop /dev/gpt/data05.nop

zpool import zdata

zdb -C zdata | grep ashift => Hier steht 12!

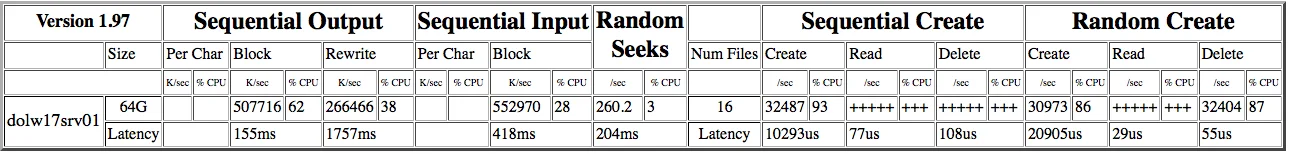

Leider werde ich nicht ganz schlau aus den Werten.

Ist die Lese- und Schreibgeschwindigkeit jetzt so ca. 450-500 MB/s?

Ist es problematisch, dass die CPU-Belastung teilweise so hoch ist?

Ich habe einen Core i7 2600k, 32 GB RAM und einen auf den IT-Mode geflasheden IBM 1015.

Danke und Gruß

Markus

PS: Die Messergebnisse nach Hinzufügen der Caches reiche ich natürlich nach - wollte erstmal hören, ob ich bei der Erstellung evtl. etwas falsch gemacht habe...1

ich habe meinen Server auf FreeBSD migriert und bin gerade dabei den ZFS-Datenpool zu erstellen und zu testen.

Dazu habe ich 6 x 3 TB Festplatten hergenommen und mittels gnop (4k) zu einem RaidZ2 zusammengeführt.

Bevor ich ZIL und L2ARC hinzufüge (jeweils zusätzliche Partitionen der System-SSDs) habe ich mal versucht mit bonnie++ einen Benchmark zu erstellen.

Bei der Einrichtung bin ich folgendermaßen vorgegangen:

Anlegen fester Partitionsgrößen (teilweise unterscheiden sich die ja je nach Festplatte)

gpart create -s GPT da0

gpart create -s GPT da1

gpart create -s GPT da2

gpart create -s GPT da3

gpart create -s GPT da4

gpart create -s GPT da5

gpart add -b 2048 -s 5860333168 -t freebsd-zfs -l data00 da0

gpart add -b 2048 -s 5860333168 -t freebsd-zfs -l data01 da1

gpart add -b 2048 -s 5860333168 -t freebsd-zfs -l data02 da2

gpart add -b 2048 -s 5860333168 -t freebsd-zfs -l data03 da3

gpart add -b 2048 -s 5860333168 -t freebsd-zfs -l data04 da4

gpart add -b 2048 -s 5860333168 -t freebsd-zfs -l data05 da5

4k-Thematik

gnop create -S 4096 /dev/gpt/data00

gnop create -S 4096 /dev/gpt/data01

gnop create -S 4096 /dev/gpt/data02

gnop create -S 4096 /dev/gpt/data03

gnop create -S 4096 /dev/gpt/data04

gnop create -S 4096 /dev/gpt/data05

zpool create zdata raidz2 /dev/gpt/data00.nop /dev/gpt/data01.nop /dev/gpt/data02.nop /dev/gpt/data03.nop /dev/gpt/data04.nop /dev/gpt/data05.nop

zpool export zdata

gnop destroy /dev/gpt/data00.nop /dev/gpt/data01.nop /dev/gpt/data02.nop /dev/gpt/data03.nop /dev/gpt/data04.nop /dev/gpt/data05.nop

zpool import zdata

zdb -C zdata | grep ashift => Hier steht 12!

Leider werde ich nicht ganz schlau aus den Werten.

Ist die Lese- und Schreibgeschwindigkeit jetzt so ca. 450-500 MB/s?

Ist es problematisch, dass die CPU-Belastung teilweise so hoch ist?

Ich habe einen Core i7 2600k, 32 GB RAM und einen auf den IT-Mode geflasheden IBM 1015.

Danke und Gruß

Markus

PS: Die Messergebnisse nach Hinzufügen der Caches reiche ich natürlich nach - wollte erstmal hören, ob ich bei der Erstellung evtl. etwas falsch gemacht habe...1